Gemma 4 là gì? Phân tích chi tiết mô hình AI mới nhất từ Google

17/04/2026AI đang dần chuyển từ cloud sang mô hình triển khai linh hoạt, câu hỏi lớn của doanh nghiệp thường đặt là “AI có thể chạy ở đâu và chi phí ra sao”. Gemma 4 chính là câu trả lời mới nhất từ Google DeepMind, khi đưa sức mạnh của mô hình Gemini xuống các hệ thống có thể vận hành ngay trên máy cá nhân, server nội bộ hoặc edge device.

Gemma 4 không chỉ là một mô hình AI mới mà phản ánh một xu hướng rõ ràng: AI đang chuyển từ dịch vụ API sang hạ tầng mà doanh nghiệp có thể tự kiểm soát. Khi chi phí inference trở thành yếu tố quyết định, các model open-weight như Gemma 4 sẽ đóng vai trò trung tâm trong chiến lược AI dài hạn.

Doanh nghiệp nào làm chủ được hạ tầng AI sớm sẽ có lợi thế lớn về chi phí, tốc độ triển khai và khả năng mở rộng sản phẩm trong giai đoạn tới. Cùng VNSO tìm hiểu tất cả thông tin bạn cần biết về Gemma 4.

Gemma 4 là gì?

Gemma là dòng mô hình AI (AI Model) open-weight do Google DeepMind phát triển, cho phép chạy local, tùy chỉnh và triển khai linh hoạt trên nhiều loại hạ tầng. AI Model Gemma 4 là thế hệ thứ tư trong dòng mô hình AI “open-weight”, được xây dựng trực tiếp từ nền tảng nghiên cứu của Gemini.

Open-weight là mô hình AI được công khai trọng số (weights) đã huấn luyện, cho phép tải về, chạy local và fine-tune theo nhu cầu, nhưng không nhất thiết công khai toàn bộ dữ liệu hoặc quy trình huấn luyện.

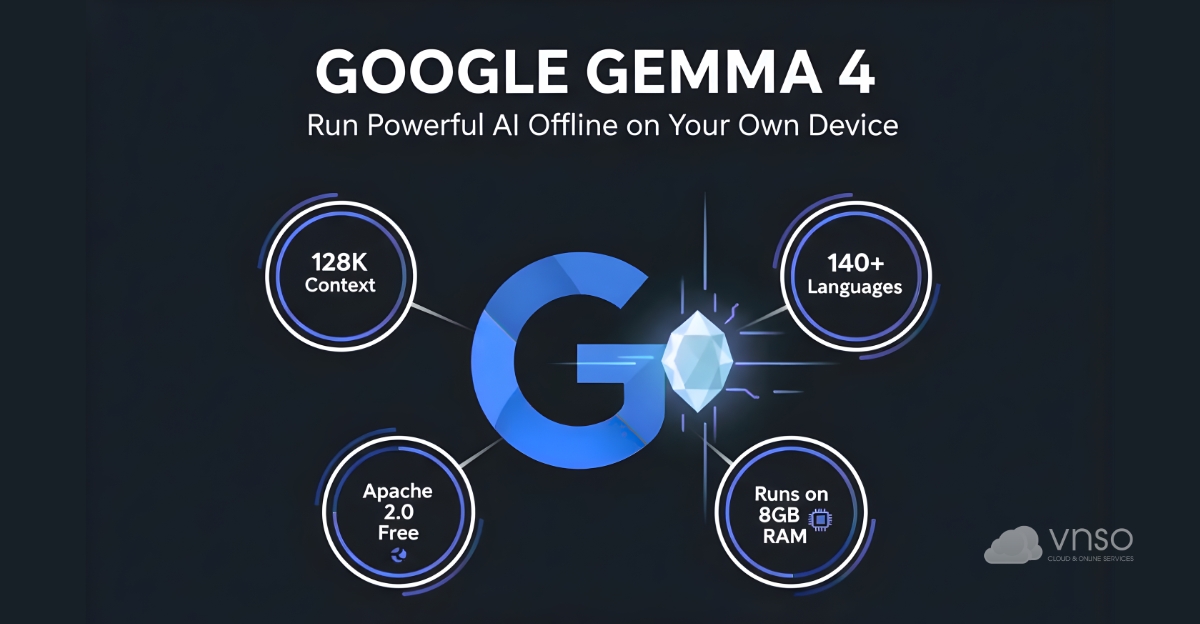

Khác với các mô hình AI đóng (closed models), Gemma 4 cho phép tải về và chạy trên thiết bị riêng. Tùy chỉnh theo nhu cầu và triển khai thương mại không bị hạn chế.

Điểm quan trọng nhất là Google đã chuyển sang giấy phép Apache 2.0, giúp doanh nghiệp có thể sử dụng và phát triển sản phẩm AI mà không bị ràng buộc pháp lý như trước. Theo Google, đây là “mô hình open mạnh nhất tính theo từng tham số (intelligence-per-parameter)”, một cách đo hiệu quả thay vì chỉ nhìn vào kích thước model.

Bước tiến lớn: từ AI cloud sang AI “chạy mọi nơi”

Gemma 4 được thiết kế với triết lý hoàn toàn khác so với các model truyền thống. Thay vì yêu cầu hạ tầng GPU lớn, model này có thể chạy trên laptop, workstation, chạy trên thiết bị edge (IoT, mobile) và triển khai trong datacenter hoặc hybrid cloud.

Google xác nhận các phiên bản nhỏ như E2B và E4B có thể hoạt động offline với độ trễ gần như bằng 0 trên thiết bị edge. Điều này mở ra một xu hướng rõ ràng: AI không còn phụ thuộc hoàn toàn vào cloud, mà chuyển sang mô hình “local-first AI”.

>>> Có thể bạn quan tâm Top 5 GPU cho AI tốt nhất hiện nay – Giải pháp tối ưu hiệu năng

Kiến trúc Gemma 4: Tối ưu hiệu năng trên từng tài nguyên

Một trong những điểm nâng cấp quan trọng nhất của Gemma 4 nằm ở kiến trúc.

Mixture-of-Experts (MoE)

Gemma 4 sử dụng kiến trúc MoE, chỉ kích hoạt một phần nhỏ tham số khi xử lý mỗi token. Vì vậy, Model giảm chi phí tính toán, giảm VRAM sử dụng, giúp tăng tốc inference.

Một nghiên cứu benchmark cho thấy hiệu quả thực tế là điểm mạnh cốt lõi:

– Gemma 4 E4B đạt độ chính xác tổng hợp 0.675

– Sử dụng khoảng 14.9GB VRAM

– Trong khi model lớn hơn (26B) tiêu tốn tới 48.1GB VRAM

“Thinking model”, khả năng suy luận nhiều bước

Gemma 4 giới thiệu các biến thể “thinking” với khả năng suy luận nhiều bước, cho phép mô hình xử lý các bài toán logic phức tạp một cách có hệ thống. Nhờ được huấn luyện để “suy nghĩ trước khi trả lời”, các model này cải thiện rõ rệt hiệu quả trong các tác vụ như lập trình, phân tích dữ liệu và xây dựng AI agent, nơi yêu cầu chuỗi reasoning chính xác và nhất quán.

>>> Xem thêm Thuê GPU Train Model cho mọi mô hình AI đơn giản, tiết kiệm

Multimodal native (đa phương thức)

Bên cạnh đó, Gemma 4 còn hỗ trợ multimodal native, cho phép xử lý trực tiếp văn bản, hình ảnh và âm thanh trong cùng một kiến trúc. Khác với các thế hệ trước phải kết hợp nhiều mô hình riêng lẻ, toàn bộ các modality đã được tích hợp ngay từ lõi hệ thống, giúp tối ưu hiệu năng, giảm độ trễ và đơn giản hóa quá trình triển khai thực tế.

Hiệu năng Gemma 4: Số liệu benchmark đáng chú ý

Google công bố nhiều benchmark cho thấy Gemma 4 đạt hiệu năng cao trên nhiều tác vụ:

– MMMLU (đa ngôn ngữ): đạt 85.2% với model 31B

– AIME 2026 (toán học): đạt 89.2%

– LiveCodeBench (coding): đạt 80%

– GPQA (khoa học): đạt 84.3%

Ngoài ra còn hỗ trợ hơn 140 ngôn ngữ và tối ưu cho agent workflows và function calling. Những con số này cho thấy Gemma 4 không chỉ là model “nhẹ” mà còn đủ mạnh để xử lý các bài toán thực tế như coding, phân tích dữ liệu và automation.

Hệ sinh thái Gemma: quy mô và tốc độ phát triển

Gemma không phải là một dự án thử nghiệm nhỏ lẻ mà đã nhanh chóng trở thành một hệ sinh thái AI có quy mô lớn.

Tính đến năm 2026, dòng model này ghi nhận hơn 400 triệu lượt tải và hơn 100.000 biến thể được cộng đồng phát triển, phản ánh mức độ quan tâm mạnh mẽ từ cả developer lẫn doanh nghiệp.

Từ đó hình thành nên “Gemmaverse”, nơi các nhà phát triển liên tục chia sẻ các phiên bản fine-tune, doanh nghiệp có thể rút ngắn thời gian triển khai AI vào sản phẩm, đồng thời cộng đồng đóng vai trò quan trọng trong việc cải tiến và mở rộng năng lực mô hình theo thời gian.

Các phiên bản trong Gemma 4

Gemma 4 được thiết kế theo nhiều phân khúc nhằm đáp ứng đa dạng nhu cầu sử dụng, từ thiết bị edge đến hệ thống hiệu năng cao. Các phiên bản như E2B (~2B) hướng đến môi trường mobile và IoT với yêu cầu tài nguyên thấp, trong khi E4B (~4B) phù hợp cho laptop hoặc các hệ thống AI chạy local.

Ở phân khúc cao hơn, model 26B sử dụng kiến trúc MoE giúp cân bằng giữa hiệu năng và chi phí vận hành, còn phiên bản 31B dense tập trung vào các tác vụ đòi hỏi độ chính xác và khả năng suy luận cao. Cách phân tầng này giúp doanh nghiệp dễ dàng lựa chọn mô hình phù hợp dựa trên ngân sách, hạ tầng GPU hiện có và mục tiêu triển khai cụ thể.

So sánh Gemma 4 với các AI Model cạnh tranh trên thị trường và Gemini

Gemma 4 khác gì so với các đối thủ?

Nhìn tổng thể, Gemma 4 nổi bật ở hiệu quả trên từng tài nguyên và khả năng triển khai linh hoạt. Trong khi Llama 3 mạnh về hệ sinh thái và Mistral tối ưu tốc độ, Gemma 4 cân bằng tốt giữa hiệu năng, chi phí và khả năng mở rộng thực tế.

| Tiêu chí | Gemma 4 | Llama 3 | Mistral |

|---|---|---|---|

| Loại model | Open-weight (Apache 2.0) | Open-weight (Meta license) | Open-weight |

| Điểm mạnh | Hiệu năng/param cao, multimodal | Cộng đồng lớn, ổn định | Tối ưu tốc độ, nhẹ |

| Kiến trúc | Dense + MoE | Dense | Dense + MoE |

| Context | Tới 256K tokens | ~8K–128K | ~32K–128K |

| Multimodal | Có (native) | Hạn chế | Hạn chế |

| Use case | Local AI, agent, enterprise | Chatbot, general AI | App nhẹ |

Gemma 4 khác gì Gemini?

Dù cùng được phát triển dựa trên nền tảng nghiên cứu của Google DeepMind, Gemma 4 và Gemini phục vụ hai định hướng hoàn toàn khác nhau. Gemini là mô hình đóng, vận hành trên cloud và được tối ưu dưới dạng dịch vụ API, phù hợp cho các ứng dụng cần tích hợp nhanh mà không quan tâm đến hạ tầng phía sau.

Trong khi đó, Gemma 4 là mô hình open-weight, có thể chạy local và được thiết kế để tối ưu cho việc triển khai thực tế trong nhiều môi trường khác nhau.

Có thể hiểu đơn giản, nếu Gemini là một dịch vụ AI sẵn dùng, thì Gemma 4 đóng vai trò như một lớp hạ tầng AI mà doanh nghiệp có thể chủ động kiểm soát và tùy biến.

Ứng dụng thực tế của Gemma 4

Nhờ tính linh hoạt trong triển khai, Gemma 4 phù hợp với nhiều kịch bản thực tế từ doanh nghiệp đến sản phẩm và hạ tầng.

Trong môi trường doanh nghiệp, mô hình có thể được sử dụng để xây dựng chatbot nội bộ, phân tích các tài liệu dài lên tới 256K tokens hoặc triển khai các AI agent tự động hóa quy trình.

Ở cấp độ sản phẩm, Gemma 4 cho phép tích hợp AI trực tiếp vào ứng dụng mobile và xử lý dữ liệu ngay trên thiết bị mà không cần phụ thuộc vào cloud.

Với hạ tầng, mô hình có thể chạy trên server GPU hoặc triển khai theo mô hình hybrid giữa cloud và on-premise, giúp tối ưu cả hiệu năng lẫn chi phí vận hành.

Gemma cần cấu hình nào để chạy? Chi phí triển khai Gemma 4 thực tế

Yêu cầu hạ tầng của Gemma 4 được đánh giá là linh hoạt hơn so với nhiều model cùng phân khúc. Chi phí triển khai Gemma 4 phụ thuộc trực tiếp vào kích thước model và hình thức vận hành.

Với các model nhỏ như E2B hoặc E4B, doanh nghiệp có thể chạy trên GPU tầm trung với khoảng 12–16GB VRAM. Điều này cho phép triển khai ngay trên workstation hoặc Cloud GPU chi phí thấp, phù hợp cho thử nghiệm và ứng dụng nhỏ.

Ở phân khúc cao hơn, model 26B (MoE) thường yêu cầu khoảng 40–80GB VRAM tùy cấu hình tối ưu. Đây là mức phổ biến khi triển khai trên các GPU như NVIDIA A100 hoặc NVIDIA L40S.

So với việc sử dụng API AI trên cloud, chi phí inference dài hạn khi self-host Gemma 4 có thể giảm đáng kể, đặc biệt với các hệ thống xử lý liên tục như chatbot, AI agent hoặc phân tích dữ liệu lớn. Thay vì trả phí theo request, doanh nghiệp chuyển sang mô hình đầu tư hạ tầng và tối ưu vận hành.

Trong thực tế, nhiều doanh nghiệp lựa chọn mô hình hybrid, kết hợp giữa cloud GPU và hạ tầng on-premise để cân bằng giữa chi phí và hiệu năng. Đây cũng là hướng triển khai phổ biến cho các hệ thống AI hiện đại.

>>> Xem thêm: NVIDIA A100 là gì? Phân tích chi tiết từ A-Z

Vì sao Gemma 4 quan trọng với doanh nghiệp?

Gemma 4 là bước chuyển chiến lược. Thứ nhất, giảm phụ thuộc cloud. Doanh nghiệp có thể kiểm soát dữ liệu và chi phí tốt hơn. Thứ hai, tối ưu chi phí hạ tầng. MoE và model nhỏ giúp giảm yêu cầu GPU.

Tiếp theo là tăng tốc triển khai AI, Không cần xây từ đầu, chỉ cần fine-tune. Cuối cùng, Gemma 4 phù hợp xu hướng “Sovereign AI”. Dữ liệu không rời khỏi hệ thống nội bộ

Chìa khóa AI cho mọi cá nhân và doanh nghiệp

Gemma 4 là thế hệ mô hình AI open mới nhất của Google DeepMind, kết hợp giữa hiệu năng cao, khả năng chạy local và tính linh hoạt trong triển khai. Với kiến trúc MoE, hỗ trợ multimodal và giấy phép Apache 2.0, đây là một trong những nền tảng quan trọng thúc đẩy xu hướng AI “chạy mọi nơi” trong giai đoạn 2026 trở đi. Gemma 4 đưa AI xuống gần hơn với doanh nghiệp, thiết bị và người dùng cuối.

Việc lựa chọn đúng hạ tầng sẽ quyết định trực tiếp đến hiệu quả khi triển khai Gemma 4. Nếu cần thử nghiệm nhanh, môi trường Cloud GPU giúp rút ngắn thời gian setup chỉ trong vài phút. Khi chuyển sang production, server GPU riêng hoặc hybrid cloud sẽ mang lại hiệu năng ổn định và tối ưu chi phí dài hạn.

VNSO hiện cung cấp đầy đủ các giải pháp từ Cloud GPU, Server GPU đến hạ tầng AI chuyên biệt, giúp doanh nghiệp triển khai Gemma 4 nhanh chóng mà không cần đầu tư ban đầu quá lớn.

Câu hỏi thường gặp về Gemma 4 (FAQ)

Gemma 4 có miễn phí không?

Gemma 4 được phát hành theo giấy phép Apache 2.0, cho phép sử dụng miễn phí, kể cả mục đích thương mại. Tuy nhiên, chi phí hạ tầng để chạy model vẫn cần được tính toán.

Model AI Gemma 4 có chạy được trên máy cá nhân không?

Các phiên bản nhỏ như E2B hoặc E4B có thể chạy trên laptop hoặc workstation có GPU phù hợp. Model lớn hơn cần GPU mạnh hơn.

Gemma 4 có thay thế ChatGPT không?

Gemma 4 không phải dịch vụ AI hoàn chỉnh mà là mô hình nền. Doanh nghiệp cần triển khai thêm hệ thống để sử dụng như một chatbot hoặc AI agent.

Có nên dùng Gemma 4 cho doanh nghiệp không?

Gemma 4 phù hợp với doanh nghiệp cần kiểm soát dữ liệu, tối ưu chi phí dài hạn và xây dựng hệ thống AI riêng thay vì phụ thuộc hoàn toàn vào API bên ngoài.

Gemma 4 phù hợp với ngành nào?

Model này phù hợp với nhiều lĩnh vực như tài chính, thương mại điện tử, SaaS, giáo dục và các hệ thống cần xử lý dữ liệu nội bộ.

Thông tin liên hệ

Để tìm hiểu thông tin về các giải pháp Máy chủ GPU, Cloud GPU, Hosting Linux & Windows, Máy chủ ảo Cloud VPS, Máy chủ vật lý, Colocation, Hệ thống lưu trữ, Cloud Server, Cloud Camera AI, Cloud Storage, Private Cloud, Enterprise Cloud, CDN, Anti-DDoS Website & Game… Quý khách vui lòng liên hệ chúng tôi theo thông tin dưới đây:

CÔNG TY CỔ PHẦN CÔNG NGHỆ VNSO – SINCE 2015

– Website: https://vnso.vn/

– Fanpage: Facebook | LinkedIn | YouTube | TikTok

– Hotline: 0927 444 222 | Email: info@vnso.vn

– Trụ sở: Lô O số 10, Đường số 15, KDC Miếu Nổi, Phường Gia Định, TP. Hồ Chí Minh

– VPGD Đà Nẵng: 30 Nguyễn Hữu Thọ, Phường Hải Châu, Đà Nẵng

– VPGD Hà Nội: 132 Vũ Phạm Hàm, Phường Yên Hòa, Hà Nội