NVIDIA A100 là gì? Phân tích GPU AI tiêu chuẩn của Data Center

15/04/2026NVIDIA A100 là GPU datacenter do NVIDIA phát triển, chuyên dùng cho AI, machine learning và tính toán hiệu năng cao (HPC). Đây là một trong những GPU phổ biến nhất trong các hệ thống AI enterprise và cloud nhờ khả năng xử lý song song mạnh và băng thông bộ nhớ rất cao.

Vậy vì sao GPU A100 này xuất hiện trong hầu hết hạ tầng AI doanh nghiệp? Cùng VNSO tìm hiểu tất cả những gì bạn cần biết về GPU NVIDIA A100, đi vào chi tiết từ kiến thức nền tảng đến ứng dụng thực tế.

Hiệu suất nổi bật của NVIDIA A100

Hiệu năng AI đạt ~312 TFLOPS, tăng tốc training và inference

A100 được thiết kế xoay quanh Tensor Core thế hệ 3, cho phép xử lý các phép toán ma trận với hiệu suất rất cao. Ở định dạng TensorFloat-32 (TF32), GPU này đạt khoảng 312 TFLOPS, trong khi với FP16 và kỹ thuật sparsity, hiệu năng thực tế trong một số bài toán có thể tăng gần gấp đôi.

Trong môi trường production, điều này tác động trực tiếp đến thời gian huấn luyện mô hình. Các workload trước đây cần nhiều ngày hoặc nhiều tuần có thể rút ngắn đáng kể khi triển khai trên cụm A100. Với inference, GPU này giúp tăng throughput, nghĩa là cùng một hệ thống có thể phục vụ nhiều người dùng hơn trong cùng thời gian.

Bộ nhớ HBM2e dung lượng lớn, băng thông gần 2 TB/s

A100 sử dụng bộ nhớ HBM2e với hai phiên bản 40GB và 80GB. Băng thông bộ nhớ đạt khoảng 1.6 TB/s đến gần 2 TB/s, cao hơn nhiều so với GPU phổ thông vốn chỉ ở mức vài trăm GB/s.

Trong các mô hình AI lớn, đặc biệt là LLM, lượng dữ liệu cần truy xuất liên tục rất lớn. Khi băng thông thấp, GPU phải chờ dữ liệu, gây lãng phí tài nguyên compute. A100 giúp GPU luôn hoạt động ở mức hiệu suất cao.

Tensor Core thế hệ 3 hỗ trợ nhiều định dạng tính toán

Tensor Core trên A100 hỗ trợ các định dạng FP16, BF16 và TF32. TF32 cho phép giữ độ chính xác gần FP32 nhưng tốc độ xử lý nhanh hơn đáng kể, phù hợp cho training mà không cần điều chỉnh nhiều.

BF16 được sử dụng rộng rãi trong các hệ thống AI hiện đại do cân bằng tốt giữa hiệu năng và độ chính xác. Nhờ hỗ trợ nhiều định dạng, A100 linh hoạt khi triển khai nhiều loại mô hình khác nhau, từ NLP đến computer vision.

Multi-Instance GPU (MIG) – Chia nhỏ hiệu năng GPU

Một GPU A100 có thể chia thành tối đa 7 instance độc lập. Nghĩa là mỗi instance có tài nguyên riêng về bộ nhớ, cache và compute, hoạt động như một GPU riêng biệt. Điều này cho phép GPU chạy song song liên tục mà không ảnh hưởng lẫn nhau.

Trong môi trường cloud hoặc doanh nghiệp, điều này giúp phân bổ tài nguyên chính xác theo nhu cầu. Một workload nhỏ không cần chiếm toàn bộ GPU, từ đó tăng hiệu suất sử dụng tổng thể và giảm chi phí vận hành.

NVLink băng thông 600 GB/s, mở rộng đa GPU hiệu quả

A100 hỗ trợ NVLink với tổng băng thông lên đến 600 GB/s giữa các GPU. Đây là yếu tố quan trọng khi xây dựng hệ thống nhiều GPU. Trong các mô hình lớn, dữ liệu cần được trao đổi liên tục giữa các GPU. NVLink giúp giảm độ trễ và tăng tốc độ truyền dữ liệu, từ đó cải thiện hiệu năng training khi scale lên nhiều GPU.

Khả năng mở rộng với NVSwitch trong hệ thống lớn

Khi kết hợp với NVSwitch, các GPU A100 có thể kết nối thành một cụm lớn với kiến trúc gần như hợp nhất. Trong các hệ thống enterprise, cụm này có thể mở rộng lên hàng chục hoặc hàng trăm GPU.

Điều này đặc biệt quan trọng với các mô hình AI quy mô lớn, nơi một GPU đơn lẻ không đủ tài nguyên. Khả năng scale tuyến tính giúp doanh nghiệp tăng năng lực xử lý theo nhu cầu thực tế.

Hiệu suất cao trong HPC và phân tích dữ liệu

A100 không chỉ phục vụ AI mà còn rất mạnh trong HPC. GPU này có thể tăng tốc các bài toán mô phỏng vật lý, tài chính định lượng và khoa học dữ liệu. Khi kết hợp với nền tảng CUDA và các thư viện tối ưu, hiệu năng xử lý có thể nhanh hơn CPU nhiều lần, đặc biệt với các bài toán cần tính toán song song quy mô lớn.

Số lượng CUDA Core của A100 đạt khoảng 6912 nhân, kết hợp với Tensor Core chuyên dụng giúp tăng tốc mạnh các phép toán deep learning. Ngoài ra, công nghệ NVLink cho phép nhiều GPU kết nối với nhau với băng thông lên đến 600 GB/s, tạo thành một hệ thống tính toán hợp nhất.

Tối ưu inference với throughput cao, độ trễ thấp

Trong các hệ thống AI production, inference là giai đoạn tiêu tốn tài nguyên nhiều nhất. A100 được tối ưu để xử lý nhiều request cùng lúc với độ trễ thấp.

Một hệ thống sử dụng A100 có thể phục vụ hàng nghìn đến hàng chục nghìn request mỗi giây, tùy vào mô hình và cấu hình. Điều này giúp các ứng dụng như chatbot, AI vision hoặc hệ thống gợi ý hoạt động ổn định khi lượng người dùng tăng. Trong các hệ thống lớn, hàng chục hoặc hàng trăm A100 có thể hoạt động cùng lúc như một “siêu máy tính AI”, phục vụ training hoặc inference ở quy mô doanh nghiệp.

Hiệu quả năng lượng và chi phí vận hành

A100 mang lại hiệu năng cao trên mỗi watt điện tiêu thụ so với các thế hệ trước. Trong môi trường datacenter, điện năng là một trong những chi phí lớn nhất. Nhờ xử lý nhanh hơn và tận dụng tài nguyên tốt hơn, doanh nghiệp có thể giảm tổng chi phí sở hữu theo thời gian. Đây là yếu tố quan trọng khi triển khai AI ở quy mô lớn và dài hạn.

Với nền tảng hiệu năng như vậy, A100 không chỉ mạnh về lý thuyết mà còn được triển khai rộng rãi trong nhiều bài toán thực tế.

NVIDIA A100 được sử dụng để làm gì?

Trong thực tế, A100 không chỉ phục vụ một lĩnh vực duy nhất mà là nền tảng chung cho nhiều hệ thống quan trọng. Dưới đây là một số công dụng chính và phổ biến của GPU NVIDIA A100

Trong AI và machine learning, A100 được sử dụng để huấn luyện các mô hình lớn như transformer hoặc LLM. Với khả năng xử lý song song và băng thông cao, thời gian training có thể giảm từ nhiều tuần xuống còn vài ngày, thậm chí vài giờ tùy quy mô hệ thống.

Trong giai đoạn vận hành, A100 đóng vai trò quan trọng trong inference. Đây là bước mô hình phục vụ người dùng cuối, ví dụ như chatbot, hệ thống gợi ý hoặc AI vision. Khả năng xử lý đồng thời nhiều request với độ trễ thấp giúp doanh nghiệp triển khai AI ở quy mô lớn.

Trong lĩnh vực phân tích dữ liệu, A100 kết hợp với các framework như RAPIDS có thể xử lý hàng tỷ dòng dữ liệu nhanh hơn CPU nhiều lần. Điều này đặc biệt quan trọng trong tài chính, nơi các mô hình dự báo và phân tích rủi ro cần tốc độ gần như real-time.

Một số ứng dụng thực tế tiêu biểu của GPU AI NVIDIA A100 (Case Study)

Các doanh nghiệp Việt sử dụng

VinBrain thuộc Vingroup đã sử dụng NVIDIA DGX A100 để phát triển AI cho chẩn đoán y khoa và chăm sóc sức khỏe. Theo CEO Trương Quốc Hùng, DGX A100 giúp train AI nhanh hơn, xử lý mô hình phức tạp hơn và cung cấp hiệu năng tính toán vượt trội so với các nền tảng NVIDIA AI trước đây.

Tiếp theo, VNPAY là một trong những doanh nghiệp fintech đầu tiên tại Đông Nam Á triển khai NVIDIA DGX A100 cho hệ sinh thái AI của mình. Hệ thống được sử dụng cho eKYC, nhận diện khuôn mặt, xử lý dữ liệu tài chính và nhiều ứng dụng AI phục vụ hơn 150 triệu người dùng mỗi tháng. Theo VNPAY, DGX A100 giúp xử lý hàng triệu tác vụ nhanh chóng, rút ngắn thời gian phản hồi xuống chỉ vài giây trong các dịch vụ mở tài khoản trực tuyến và AI fintech quy mô lớn.

Các doanh nghiệp Quốc Tế

Baseten sử dụng A100 trên hạ tầng cloud để phục vụ các mô hình AI ở môi trường thực tế. Sau khi tối ưu, thời gian khởi động model (cold start) giảm khoảng 30–60 lần, đồng thời throughput inference tăng gần 2 lần. Điều này giúp hệ thống xử lý hàng nghìn request mỗi giây với độ trễ ổn định. Xem thêm về Case Study tại đây.

BMW triển khai hệ thống AI sử dụng GPU A100 để phân tích dữ liệu sản xuất và tối ưu quy trình trong nhà máy. Nhờ khả năng xử lý song song lớn, các mô hình computer vision và phân tích dữ liệu được tăng tốc đáng kể, giúp cải thiện hiệu quả vận hành và giảm thời gian xử lý dữ liệu.

Microsoft sử dụng A100 trong các cụm GPU Azure để cung cấp dịch vụ AI cho doanh nghiệp. Một node sử dụng 8 GPU A100 có thể xử lý khối lượng lớn workload AI, từ training đến inference, cho phép scale lên hàng nghìn GPU trong các hệ thống cloud hyperscale.

Hệ thống NVIDIA DGX A100 với nhiều GPU A100 có thể đạt hiệu năng tới khoảng 2.5 petaflops AI. Trong các bài toán như BERT, thời gian training giảm gần 3 lần, trong khi inference nhanh hơn 4 lần so với thế hệ trước, giúp rút ngắn đáng kể chu kỳ phát triển mô hình.

So sánh NVIDIA A100 với các GPU AI phổ biến khác

NVIDIA A100 là một trong những GPU được sử dụng phổ biến tại Việt Nam và thế giới cho Server GPU và Cloud GPU. Hiệu năng đủ mạnh cho cả training và inference, trong khi chi phí vẫn hợp lý hơn so với thế hệ mới. Cùng so sánh nhanh NVIDIA A100 so với các GPU thông dụng khác.

– A100: lựa chọn cân bằng nhất cho doanh nghiệp

– NVIDIA H100: dành cho AI quy mô rất lớn, cần hiệu năng tối đa

– NVIDIA L40S: tối ưu chi phí, phù hợp inference và workload vừa

Bảng so sánh chi tiết NVIDIA A100 (Thông số kỹ thuật và giá trên thị trường)

Trong thực tế, A100 vẫn được sử dụng rộng rãi nhờ hệ sinh thái ổn định và khả năng triển khai linh hoạt. NVIDIA H100 phù hợp với các hệ thống AI quy mô rất lớn, trong khi L40S thường được chọn cho inference để tối ưu chi phí.

| Tiêu chí | NVIDIA A100 | NVIDIA H100 | NVIDIA L40S |

|---|---|---|---|

| Kiến trúc | Ampere (2020) | Hopper (2022) | Ada Lovelace |

| VRAM | 40GB / 80GB HBM2e | 80GB HBM3 | 48GB GDDR6X |

| Băng thông | ~1.6–2 TB/s | ~3.35 TB/s | ~864 GB/s |

| AI FP16/BF16 | ~312 TFLOPS | ~990 TFLOPS | ~362 TFLOPS |

| NVLink | Có (600 GB/s) | Có (900 GB/s) | Không |

| TDP | ~400W | ~700W | ~350W |

| Giá cloud (2026) | ~1.5 – 3.9 USD/giờ | ~3 – 5 USD/giờ | ~0.8 – 1.5 USD/giờ |

Tuy nhiên, hiệu năng cao luôn đi kèm với bài toán chi phí, đặc biệt trong các hệ thống AI vận hành liên tục.

>>> Xem thêm NVIDIA A100 vs. V100: So sánh chi tiết GPU AI

Giá NVIDIA A100 và chi phí vận hành

Chi phí của NVIDIA A100 phụ thuộc vào cách triển khai, bao gồm mua phần cứng hoặc thuê cloud GPU. Trên thị trường, giá một GPU A100 40GB thường dao động khoảng 8.000 đến 12.000 USD, trong khi phiên bản 80GB có thể từ 15.000 đến 20.000 USD. Với các hệ thống nhiều GPU như HGX hoặc DGX, tổng chi phí có thể lên đến hàng trăm nghìn USD khi tính cả server, điện năng và hạ tầng làm mát.

Trong thực tế, phần lớn doanh nghiệp lựa chọn thuê cloud GPU để tối ưu chi phí và linh hoạt mở rộng. Giá thuê A100 hiện dao động khoảng 0.7–3 USD/giờ tùy nhà cung cấp và cấu hình. Nếu vận hành liên tục, chi phí có thể từ khoảng 1.000 đến hơn 2.000 USD mỗi tháng cho một GPU.

Ngoài chi phí GPU, doanh nghiệp còn cần tính đến các yếu tố như lưu trữ, băng thông mạng, truyền dữ liệu và hiệu suất sử dụng tài nguyên. Trong nhiều trường hợp, các chi phí này có thể làm tổng chi phí tăng thêm 20–40%. Vì vậy, hiệu quả thực tế phụ thuộc nhiều vào cách tối ưu hệ thống và mức độ sử dụng GPU, hơn là chỉ giá thuê ban đầu.

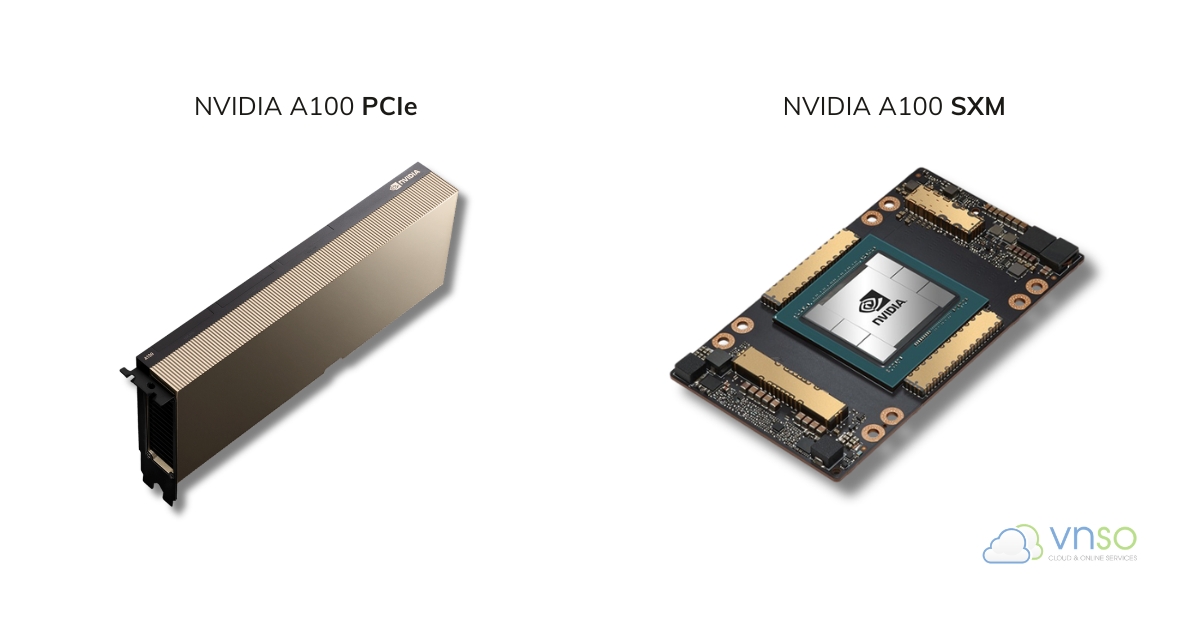

2 cách triển khai NVIDIA A100 phổ biến – Cloud GPU và Server GPU

Trong thực tế, doanh nghiệp có hai cách tiếp cận phổ biến để khai thác sức mạnh của NVIDIA A100: triển khai Server GPU riêng hoặc sử dụng Cloud GPU. Server GPU phù hợp với hệ thống cần kiểm soát toàn bộ hạ tầng và vận hành dài hạn, trong khi cloud GPU cho phép khởi tạo nhanh, mở rộng linh hoạt theo nhu cầu và tối ưu chi phí ban đầu. Tùy vào quy mô và ngân sách, việc lựa chọn mô hình triển khai phù hợp sẽ ảnh hưởng trực tiếp đến hiệu quả sử dụng GPU và tổng chi phí vận hành.

Vì sao NVIDIA A100 trở thành tiêu chuẩn của hạ tầng AI?

Một trong những lý do lớn nhất là hiệu suất trên mỗi chi phí (performance per dollar). Dù chi phí đầu tư ban đầu cao, A100 giúp giảm đáng kể thời gian xử lý và chi phí vận hành dài hạn.

Trong nhiều bài benchmark thực tế, A100 cho thấy hiệu năng cao hơn từ 2 đến 6 lần so với thế hệ trước trong các tác vụ AI phổ biến. Điều này đồng nghĩa với việc doanh nghiệp có thể giảm số lượng máy cần thiết, tiết kiệm điện năng và chi phí hạ tầng.

Ngoài ra, khả năng mở rộng là yếu tố then chốt. Với NVLink và NVSwitch, các cụm GPU A100 có thể scale lên hàng trăm GPU mà vẫn duy trì hiệu suất cao. Đây là nền tảng cho các hệ thống AI quy mô lớn như cloud hyperscale hoặc trung tâm dữ liệu AI.

Vai trò của A100 trong kỷ nguyên LLM và AI hiện đại

Khi các mô hình như LLM phát triển, nhu cầu không chỉ dừng lại ở training mà chuyển sang inference ở quy mô lớn. Đây là nơi A100 phát huy tối đa giá trị. Một hệ thống sử dụng A100 có thể phục vụ hàng nghìn đến hàng chục nghìn request mỗi giây, tùy cấu hình và mô hình. Điều này giúp các doanh nghiệp triển khai chatbot, AI assistant hoặc hệ thống tự động hóa với độ ổn định cao.

Trong bối cảnh đó, A100 là một phần của hạ tầng AI hoàn chỉnh, nơi hiệu năng, độ ổn định và khả năng mở rộng đều đóng vai trò quyết định.

Kết luận về NVIDIA A100

NVIDIA A100 là nền tảng GPU datacenter quan trọng trong các hệ thống AI hiện đại, đặc biệt ở giai đoạn vận hành và mở rộng quy mô. Với kiến trúc tối ưu cho tính toán song song, băng thông bộ nhớ cao và khả năng chia nhỏ tài nguyên, A100 giúp doanh nghiệp triển khai AI hiệu quả hơn về hiệu suất lẫn chi phí.

Dù đã có thế hệ mới, A100 vẫn giữ vai trò cân bằng giữa hiệu năng, độ ổn định và khả năng triển khai thực tế. Đây là lựa chọn phù hợp cho cả training và inference trong nhiều bài toán AI ở quy mô doanh nghiệp.

Dịch vụ cho thuê Cloud GPU và Server GPU

Thuê ngay GPU NVIDIA A100 với giải pháp NVIDIA A100 Cloud GPU tiết kiệm và Server GPU hiệu năng cao tại VNSO.

Điền thông tin, nhận ngay báo giá, tư vấn triển khai hoàn toàn miễn phí!

Một số câu hỏi thường gặp về NVIDIA A100 (FAQ)

Hai phiên bản bộ nhớ NVIDIA A100 40GB và 80GB khác gì?

NVIDIA A100 có hai phiên bản bộ nhớ là 40GB và 80GB HBM2e, phục vụ các nhu cầu khác nhau trong AI. Bản 40GB phù hợp với các workload vừa phải như training mô hình trung bình hoặc inference, giúp tối ưu chi phí. Trong khi đó, bản 80GB cung cấp dung lượng lớn hơn và băng thông cao hơn, phù hợp với các mô hình lớn như LLM hoặc hệ thống multi-GPU, nơi yêu cầu xử lý dữ liệu lớn liên tục.

NVIDIA A100 dùng để train hay inference tốt hơn?

A100 được thiết kế cho cả training và inference. Trong training, GPU này có thể tăng tốc nhiều lần so với thế hệ trước nhờ Tensor Core và kiến trúc Ampere. Trong inference, A100 có thể tăng throughput lên đến hàng trăm lần so với CPU trong một số mô hình như BERT.

NVIDIA A100 có thể thay thế CPU không?

A100 không thay thế CPU mà hoạt động như bộ tăng tốc. CPU vẫn đảm nhiệm điều phối hệ thống và xử lý logic, trong khi GPU xử lý các phép toán song song như AI hoặc dữ liệu lớn. Hai thành phần này luôn đi cùng nhau trong hạ tầng server.

MIG trên A100 là gì và có lợi ích gì?

MIG (Multi-Instance GPU) cho phép chia một A100 thành tối đa 7 GPU nhỏ độc lập. Điều này giúp nhiều workload chạy song song, tăng hiệu suất sử dụng tài nguyên và giảm chi phí vận hành.

Trong một số hệ thống thực tế, MIG có thể giúp tiết kiệm tới khoảng 40% tài nguyên GPU mà vẫn giữ nguyên hiệu năng tổng thể.

NVIDIA A100 có phù hợp cho startup không?

Có, nhưng phụ thuộc vào quy mô. Startup thường chọn thuê cloud GPU A100 để tránh chi phí đầu tư lớn ban đầu. Với các workload vừa phải hoặc inference, có thể cân nhắc GPU chi phí thấp hơn để tối ưu ngân sách.

Một hệ thống cần bao nhiêu A100 để chạy LLM?

Số lượng GPU phụ thuộc vào kích thước mô hình.

– Mô hình nhỏ (7B–13B): có thể chạy với 1–2 A100

– Mô hình lớn hơn (30B–70B): cần nhiều GPU (4–8+)

– LLM cực lớn: có thể cần hàng chục đến hàng trăm GPU

Trong các hệ thống lớn, A100 có thể scale lên hàng nghìn GPU thông qua NVLink và NVSwitch.

NVIDIA A100 có còn phù hợp trong năm 2026?

Dù đã có thế hệ mới như H100, A100 vẫn được sử dụng rộng rãi trong production. Lý do là hiệu năng ổn định, hệ sinh thái hoàn thiện và chi phí hợp lý hơn. Đây vẫn là lựa chọn phổ biến cho nhiều doanh nghiệp AI.

Hiệu suất sử dụng có thể ảnh hưởng đến chi phí như thế nào?

Một trong những yếu tố ảnh hưởng lớn nhất đến chi phí là mức độ sử dụng GPU. GPU idle vẫn bị tính phí, Over-provision (dùng GPU lớn hơn nhu cầu) gây lãng phí. Thiếu tối ưu scheduling có thể làm tăng chi phí 15–30%

Khi nào nên dùng A100 thay vì GPU khác?

A100 phù hợp khi cần Training mô hình AI lớn, Inference quy mô lớn, xử lý dữ liệu lớn với băng thông cao và mở rộng (Scale) hệ thống nhiều GPU.

Thông tin liên hệ

Để tìm hiểu thông tin về các giải pháp Máy chủ GPU, Cloud GPU, Hosting Linux & Windows, Máy chủ ảo Cloud VPS, Máy chủ vật lý, Colocation, Hệ thống lưu trữ, Cloud Server, Cloud Camera AI, Cloud Storage, Private Cloud, Enterprise Cloud, CDN, Anti-DDoS Website & Game… Quý khách vui lòng liên hệ chúng tôi theo thông tin dưới đây:

CÔNG TY CỔ PHẦN CÔNG NGHỆ VNSO – SINCE 2015

– Website: https://vnso.vn/

– Fanpage: Facebook | LinkedIn | YouTube | TikTok

– Hotline: 0927 444 222 | Email: info@vnso.vn

– Trụ sở: Lô O số 10, Đường số 15, KDC Miếu Nổi, Phường Gia Định, TP. Hồ Chí Minh

– VPGD Đà Nẵng: 30 Nguyễn Hữu Thọ, Phường Hải Châu, Đà Nẵng

– VPGD Hà Nội: 132 Vũ Phạm Hàm, Phường Yên Hòa, Hà Nội