Cloud GPU là gì? Tất cả những gì bạn cần biết về GPU Cloud

11/05/2026GPU AI hiện đại không hề rẻ. Theo CRN, GPU NVIDIA H100 từng được bán trên thị trường với mức giá khoảng 40.000 USD. Con số này chưa bao gồm chi phí máy chủ, điện năng, hệ thống làm mát và networking datacenter. Đó là lý do Cloud GPU trở thành lựa chọn ngày càng phổ biến.

Thay vì phải đầu tư hạ tầng GPU vật lý với chi phí cực lớn, doanh nghiệp giờ đây có thể thuê GPU hiệu năng cao trực tiếp từ cloud để triển khai AI nhanh hơn, linh hoạt hơn và tối ưu chi phí hơn.

Cloud GPU là gì?

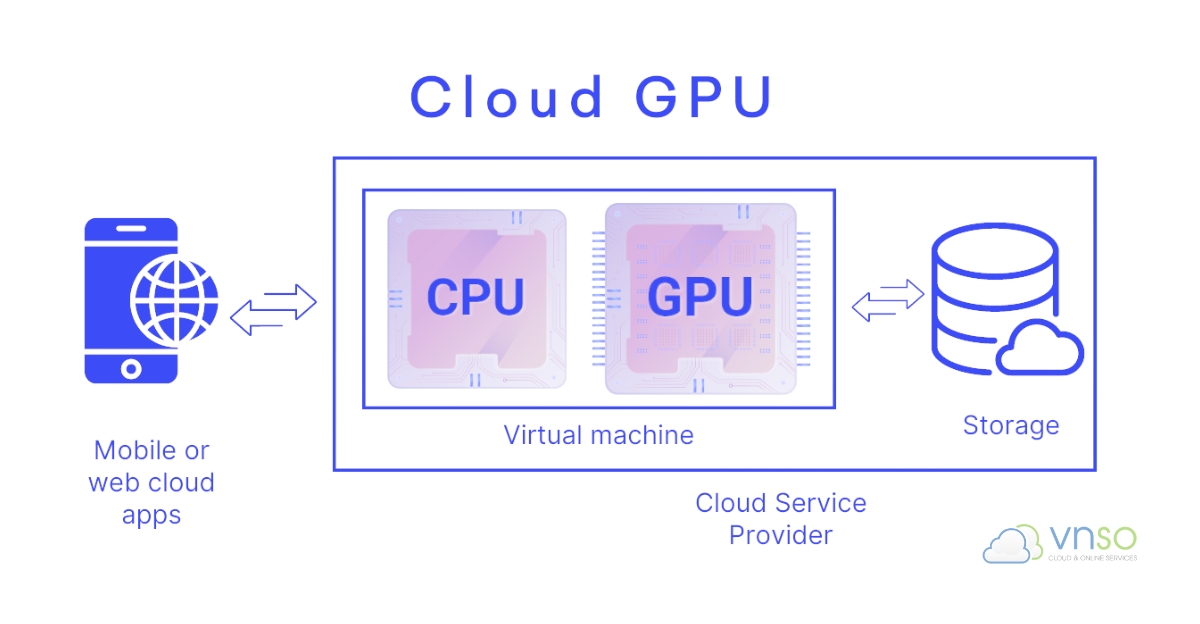

Cloud GPU là dịch vụ cung cấp tài nguyên GPU thông qua nền tảng điện toán đám mây (cloud computing). GPU vật lý được đặt trong datacenter của nhà cung cấp và người dùng truy cập từ xa thông qua internet để xử lý AI, machine learning, rendering hoặc các workload tính toán hiệu năng cao.

CPU truyền thống được thiết kế cho xử lý tuần tự với số lượng nhân ít nhưng mạnh. Trong khi đó, GPU được tối ưu cho xử lý song song với hàng nghìn lõi hoạt động cùng lúc.

Cloud GPU giống như việc thuê sức mạnh GPU từ xa thay vì phải sở hữu phần cứng vật lý. Người dùng chỉ cần tạo GPU instance trên cloud để bắt đầu sử dụng ngay lập tức.

>>> Xem thêm: Top 10 nhà cung cấp dịch vụ thuê Cloud GPU cho AI năm 2026

Nền tảng GPU (GPU Platforms)

GPU Platforms là khái niệm rộng hơn, bao gồm toàn bộ hệ sinh thái GPU cloud như phần cứng GPU, hệ thống networking, storage tốc độ cao, virtualization, orchestration và AI software stack.

Các nền tảng lớn hiện nay như NVIDIA DGX Cloud, Google Cloud GPU hay AWS EC2 GPU Instances đều đang xây dựng hệ sinh thái AI infrastructure hoàn chỉnh thay vì chỉ đơn thuần cung cấp GPU. Theo NVIDIA, accelerated computing hiện là nền tảng cốt lõi cho AI, HPC và datacenter thế hệ mới. Điểm khác biệt lớn nhất nằm ở khả năng xử lý song song của GPU.

Lợi ích Cloud GPU cho cá nhân, startup và doanh nghiệp

Trước đây, việc xây dựng AI quy mô lớn gần như chỉ dành cho các tập đoàn công nghệ có ngân sách rất lớn. Cloud GPU đã thay đổi hoàn toàn điều đó.

Hiện nay, startup nhỏ hoặc đội ngũ nghiên cứu độc lập vẫn có thể truy cập GPU datacenter mạnh để train model AI, xây dựng chatbot, phát triển AI SaaS hoặc triển khai inference API mà không cần tự xây dựng hạ tầng riêng.

Mô hình pay-as-you-go giúp giảm đáng kể rào cản tiếp cận AI infrastructure. Đây cũng là một trong những lý do khiến thị trường AI startup tăng trưởng cực nhanh trong vài năm gần đây.

Giảm áp lực đầu tư hạ tầng AI ban đầu

Trong thực tế, để vận hành một AI server hoàn chỉnh, doanh nghiệp còn cần đầu tư CPU hiệu năng cao, RAM ECC dung lượng lớn, NVMe storage tốc độ cao và hạ tầng networking đủ mạnh để tránh bottleneck dữ liệu. Tổng chi phí triển khai thường lớn hơn rất nhiều so với giá card GPU riêng lẻ.

Cloud GPU giúp doanh nghiệp tiếp cận sức mạnh AI datacenter mà không cần bỏ ra khoản CAPEX khổng lồ ngay từ đầu. Đây là lợi thế rất lớn với startup AI, đội ngũ R&D hoặc doanh nghiệp đang thử nghiệm sản phẩm AI mới trước khi scale lớn.

Triển khai AI nhanh hơn nhiều so với hạ tầng vật lý

GPU AI cao cấp hiện liên tục rơi vào tình trạng khan hiếm do nhu cầu toàn cầu tăng quá nhanh. Reuters cho biết nhiều hyperscaler (nhà cung cấp siêu quy mô) đang chi hàng chục tỷ USD để mở rộng AI infrastructure nhằm đáp ứng nhu cầu compute ngày càng lớn.

Nếu tự xây dựng hạ tầng vật lý, doanh nghiệp thường phải trải qua quá trình khá dài gồm đặt mua GPU, chờ nhập hàng, lắp đặt server, triển khai networking, cấu hình hệ thống và tối ưu cooling. Toàn bộ quá trình này có thể kéo dài từ vài tuần tới nhiều tháng.

Trong khi đó, Cloud GPU cho phép khởi tạo GPU instance gần như ngay lập tức. Điều này giúp đội ngũ AI bắt đầu training model, triển khai inference hoặc thử nghiệm workload mới nhanh hơn rất nhiều. Với thị trường AI thay đổi liên tục như hiện nay, tốc độ triển khai đôi khi còn quan trọng hơn cả phần cứng.

Linh hoạt mở rộng theo nhu cầu thực tế

Workload AI thường không cố định. Có thời điểm doanh nghiệp chỉ cần một GPU cho inference cơ bản, nhưng khi train model lớn hoặc chạy AI campaign mới, nhu cầu compute có thể tăng mạnh chỉ trong thời gian ngắn.

Cloud GPU cho phép mở rộng tài nguyên linh hoạt mà không cần đầu tư thêm phần cứng vật lý. Doanh nghiệp có thể tăng số lượng GPU trong vài phút, nâng cấp từ RTX 4090 lên A100 hoặc H100, thậm chí mở rộng multi-GPU cluster để xử lý workload lớn hơn.

Đây là điểm khác biệt rất lớn so với mô hình server truyền thống, nơi doanh nghiệp thường phải đầu tư hạ tầng dư thừa từ đầu để chuẩn bị cho khả năng scale trong tương lai.

Tối ưu cho AI và machine learning

Toàn bộ hạ tầng được thiết kế để tối ưu riêng cho AI workload. Khác với VPS truyền thống chủ yếu tập trung vào CPU, GPU cloud hỗ trợ CUDA, Tensor Cores, HBM memory bandwidth cao và các AI software stack chuyên dụng.

Điều này giúp Cloud GPU xử lý các workload như LLM, Stable Diffusion, computer vision, AI video hoặc speech AI hiệu quả hơn rất nhiều so với hạ tầng CPU truyền thống.

Tăng hiệu năng cho AI inference

AI hiện không còn chỉ xoay quanh training model. Inference đang trở thành thị trường tăng trưởng nhanh hơn rất nhiều khi AI bắt đầu được tích hợp vào sản phẩm thực tế.

Inference là quá trình AI tạo phản hồi cho người dùng sau khi model đã được huấn luyện. Đây là nền tảng phía sau chatbot AI, AI tạo ảnh, AI search hoặc recommendation system.

“Inference hiện là một trong những workload tăng trưởng nhanh nhất trong AI datacenter toàn cầu” -NVIDIA

Cloud GPU giúp inference đạt latency thấp hơn, throughput cao hơn và xử lý đồng thời nhiều request AI hơn. Điều này đặc biệt quan trọng với các sản phẩm AI production cần phản hồi nhanh và ổn định cho lượng lớn người dùng cùng lúc.

Tăng độ ổn định và khả năng vận hành hệ thống

Cloud GPU hiện đại không chỉ cung cấp GPU mà còn đi kèm toàn bộ hệ sinh thái vận hành như monitoring, backup, orchestration, failover và networking redundancy. Điều này đặc biệt quan trọng với các doanh nghiệp triển khai AI quy mô lớn hoặc cần hệ thống hoạt động liên tục 24/7.

Cloud GPU hoạt động như thế nào?

Cloud GPU hoạt động bằng cách cấp phát tài nguyên GPU từ các cụm server vật lý trong datacenter.

Khi người dùng tạo một GPU instance, hệ thống sẽ phân bổ GPU phù hợp, cấp CPU, RAM và storage đi kèm rồi cho phép truy cập từ xa thông qua internet hoặc private network.

Nhiều nền tảng cloud hiện sử dụng công nghệ GPU virtualization nhằm chia nhỏ GPU vật lý thành nhiều instance khác nhau để tối ưu tài nguyên. Theo OVHcloud, đây là một trong những yếu tố giúp Cloud GPU trở nên linh hoạt hơn rất nhiều so với mô hình server truyền thống.

Một công nghệ nổi bật hiện nay là MIG (Multi-Instance GPU) trên NVIDIA H100 và A100. Công nghệ này cho phép chia một GPU thành nhiều instance độc lập để phục vụ nhiều workload khác nhau cùng lúc. NVIDIA cho biết mỗi instance MIG có thể hoạt động gần như tách biệt, giúp tối ưu khả năng khai thác GPU trong môi trường cloud.

Ngoài GPU, networking cũng đóng vai trò cực kỳ quan trọng trong AI infrastructure hiện đại. Các AI cluster lớn thường sử dụng NVLink, PCIe Gen 5 hoặc InfiniBand để giảm bottleneck khi nhiều GPU hoạt động song song.

Các ứng dụng phổ biến của Cloud GPU

AI Training

Ứng dụng lớn nhất hiện nay của Cloud GPU là AI training.

Training AI là quá trình huấn luyện model học từ dữ liệu. Công việc này yêu cầu GPU xử lý khối lượng phép tính cực lớn trong thời gian dài. Theo Lambda Labs, chi phí compute để train GPT-3 theo giá cloud thương mại có thể lên tới hàng triệu USD.

AI Inference

Cloud GPU cũng là nền tảng quan trọng cho AI inference. Đây là quá trình model AI tạo phản hồi sau khi đã được huấn luyện xong. Chatbot AI, AI tạo ảnh, recommendation system hoặc AI voice đều là các ví dụ điển hình của inference workload.

Theo NVIDIA, inference hiện là một trong những mảng tăng trưởng nhanh nhất trong AI datacenter vì AI đang được tích hợp vào ngày càng nhiều sản phẩm thực tế.

Đồ họa 3D, Render

Ngoài AI, Cloud GPU còn được sử dụng rất nhiều trong rendering và VFX. Các studio phim, animation và game sử dụng GPU cloud để tăng tốc render video, dựng hình 3D và xử lý kỹ xảo. Theo Autodesk, GPU rendering nhanh hơn đáng kể so với CPU rendering trong nhiều workload đồ họa hiện đại.

HPC và khoa học dữ liệu

Trong lĩnh vực HPC và khoa học dữ liệu, GPU hiện được dùng cho mô phỏng vật lý, nghiên cứu protein, khí tượng, tài chính và phân tích dữ liệu lớn. Theo bảng xếp hạng TOP500, phần lớn siêu máy tính mạnh nhất thế giới hiện đều sử dụng GPU accelerator.

Các ứng dụng AI hiện đại của Cloud GPU

Ngoài AI training và inference truyền thống, Cloud GPU hiện còn được sử dụng rộng rãi trong AI video generation, AI agents, RAG chatbot, AI coding assistants, voice AI, recommendation system cho ecommerce và biomedical AI.

Nhiều nền tảng AI lớn hiện phụ thuộc gần như hoàn toàn vào GPU cloud để vận hành mô hình AI quy mô lớn. OpenAI được cho là sử dụng hàng chục nghìn GPU NVIDIA để train và vận hành GPT models. Tesla cũng xây dựng GPU cluster riêng cho autonomous driving AI, trong khi Meta đang đầu tư hàng trăm nghìn GPU cho hệ sinh thái Llama và generative AI.

Chi phí đầu tư Cloud GPU vào 2026

Theo báo cáo của McKinsey, Generative AI có thể tạo ra từ 2.6 đến 4.4 nghìn tỷ USD giá trị kinh tế mỗi năm trên toàn cầu. Đi cùng với đó là cuộc đua đầu tư hạ tầng AI như Cloud GPU quy mô hàng chục tỷ USD từ các hãng công nghệ lớn như Microsoft, Google, Amazon và Oracle.

Chi phí Cloud GPU phụ thuộc vào loại GPU, dung lượng VRAM, networking và hình thức thuê dedicated hoặc shared GPU.

Giá thuê Cloud GPU trên thị trường

Theo thông tin thị trường giá thuê RTX 4090 cloud thường dao động khoảng 0,5 đến 1,5 USD mỗi giờ, trong khi NVIDIA A100 80GB có thể dao động khoảng 2 đến 4 USD mỗi giờ. Với NVIDIA H100, mức giá có thể đạt khoảng 4 đến 10 USD mỗi giờ tùy hạ tầng và khu vực datacenter.

>>> Xem thêm: NVIDIA A100 là gì? Phân tích chi tiết từ A-Z

GPU càng mạnh thì chi phí càng cao. Tuy nhiên, lựa chọn GPU không nên chỉ dựa trên hiệu năng tối đa mà cần dựa trên workload thực tế. Ví dụ, chatbot AI nhỏ hoặc inference API cơ bản thường không cần tới H100. Trong nhiều trường hợp, RTX 4090 hoặc A100 đã đủ đáp ứng nhu cầu với chi phí thấp hơn đáng kể.

Một yếu tố khác thường bị bỏ qua là tổng chi phí vận hành. Ngoài GPU, doanh nghiệp còn cần tính thêm storage tốc độ cao, bandwidth mạng, data transfer và thời gian hoạt động liên tục. Nếu workload AI chạy 24/7 trong thời gian dài, doanh nghiệp nên phân tích kỹ giữa việc thuê Cloud GPU, colocated GPU server hoặc xây dựng private GPU cluster để tối ưu chi phí lâu dài.

Dịch vụ cho thuê Cloud GPU tại Việt Nam hiệu năng cao chỉ từ 59K/giờ

Tại Việt Nam, VNSO hiện cung cấp dịch vụ Cloud GPU và GPU Server dành cho AI training, inference, rendering và HPC với mức giá tối ưu hơn đáng kể so với nhiều nền tảng quốc tế.

Nổi bật là gói Cloud GPU NVIDIA A100 chỉ từ 59.000 VNĐ/giờ.

Ngoài Cloud GPU theo giờ, VNSO còn cung cấp GPU Server riêng hiệu năng cao với nhiều cấu hình RTX 3090, A100, H100 và các dòng GPU AI chuyên dụng giúp doanh nghiệp dễ dàng scale hạ tầng theo nhu cầu thực tế.

>>> Liên hệ ngay VNSO để được tư vấn, hướng dẫn triển khai GPU AI miễn phí:

Tổng kết về Cloud GPU

Cloud GPU đang trở thành nền tảng hạ tầng cốt lõi của thời đại AI. Doanh nghiệp giờ đây có thể tiếp cận sức mạnh GPU datacenter chỉ trong vài phút thông qua cloud. Ngày càng nhiều startup AI, doanh nghiệp công nghệ và đội ngũ R&D chuyển sang sử dụng Cloud GPU để train model, triển khai inference, xây dựng AI SaaS hoặc mở rộng hạ tầng AI production mà không cần đầu tư CAPEX quá lớn ngay từ đầu.

Nếu doanh nghiệp đang cần hạ tầng GPU hiệu năng cao cho AI training, inference hoặc rendering, VNSO có thể hỗ trợ tư vấn và triển khai nhanh theo nhu cầu thực tế.

Các câu hỏi thường gặp về Cloud GPU (FAQ)

Cloud GPU có cần biết lập trình mới sử dụng được không?

Không nhất thiết. Hiện nay nhiều nền tảng Cloud GPU đã hỗ trợ sẵn môi trường AI như Jupyter Notebook, Docker, PyTorch hoặc TensorFlow được cài đặt trước. Người mới vẫn có thể bắt đầu với các workflow AI cơ bản mà không cần tự cấu hình toàn bộ hệ thống từ đầu.

Thuê Cloud GPU theo giờ hay theo tháng sẽ tối ưu hơn?

Điều này phụ thuộc vào workload thực tế. Nếu chỉ cần test model, train ngắn hạn hoặc chạy dự án theo thời vụ, thuê theo giờ thường tối ưu hơn. Ngược lại, với workload AI chạy liên tục 24/7, thuê theo tháng hoặc GPU Server riêng thường giúp tiết kiệm chi phí lâu dài hơn.

Có thể dùng nhiều GPU cùng lúc để train AI không?

Có. Nhiều hệ thống Cloud GPU hiện hỗ trợ multi-GPU và GPU cluster để tăng tốc training AI. Các framework như PyTorch Distributed hoặc DeepSpeed có thể tận dụng nhiều GPU cùng lúc nhằm giảm thời gian huấn luyện model lớn.

Cloud GPU có phù hợp cho fine-tuning LLM không?

Rất phù hợp. Hiện nay nhiều doanh nghiệp sử dụng Cloud GPU để fine-tune các mô hình như Llama, Mistral hoặc Qwen thay vì train model từ đầu. Điều này giúp tiết kiệm compute và giảm đáng kể chi phí AI.

Vì sao bandwidth mạng quan trọng với Cloud GPU?

Khi AI workload xử lý dữ liệu lớn hoặc nhiều GPU hoạt động song song, tốc độ truyền dữ liệu giữa GPU, storage và networking ảnh hưởng trực tiếp tới hiệu năng tổng thể. Đây là lý do các AI datacenter hiện đại thường sử dụng networking tốc độ cao như InfiniBand hoặc NVLink.

Cloud GPU có thể thay thế workstation vật lý không?

Trong nhiều trường hợp là có. Nhiều designer, studio hoặc kỹ sư AI hiện sử dụng Cloud GPU thay cho workstation cục bộ để render 3D, train AI hoặc xử lý video nhờ khả năng scale linh hoạt và hiệu năng mạnh hơn đáng kể.

Doanh nghiệp nhỏ có nên đầu tư GPU server riêng ngay từ đầu không?

Thông thường chưa cần thiết. Với startup hoặc doanh nghiệp mới triển khai AI, Cloud GPU thường linh hoạt và ít rủi ro hơn vì không cần đầu tư hạ tầng lớn ban đầu. Khi workload đã ổn định và chạy liên tục trong thời gian dài, doanh nghiệp mới nên cân nhắc GPU server riêng hoặc private cluster.

Cloud GPU có hỗ trợ Docker và Kubernetes không?

Có. Phần lớn nền tảng Cloud GPU hiện nay đều hỗ trợ Docker, Kubernetes và các công cụ orchestration để triển khai AI workload ở quy mô lớn. Đây gần như đã trở thành tiêu chuẩn trong AI infrastructure hiện đại.

GPU gaming như RTX 4090 có dùng cho AI được không?

Có. RTX 4090 hiện được rất nhiều AI startup và developer sử dụng cho inference, fine-tuning và training AI quy mô vừa nhờ hiệu năng cao và chi phí thấp hơn GPU datacenter. Tuy nhiên, với workload enterprise lớn hoặc multi-user production, GPU datacenter như A100 hoặc H100 vẫn tối ưu hơn.

Cloud GPU có phù hợp cho doanh nghiệp tại Việt Nam không?

Rất phù hợp, đặc biệt trong giai đoạn AI đang phát triển nhanh. Cloud GPU giúp doanh nghiệp tại Việt Nam tiếp cận hạ tầng AI mạnh mà không cần đầu tư datacenter hoặc hệ thống GPU vật lý với chi phí quá lớn ban đầu.

Thông tin liên hệ

Để tìm hiểu thông tin về các giải pháp Máy chủ, Thiết bị IT, và Điện toán đám mây… Quý khách vui lòng liên hệ chúng tôi theo thông tin dưới đây:

CÔNG TY CỔ PHẦN CÔNG NGHỆ VNSO – SINCE 2015

– Website: https://vnso.vn/

– Fanpage: Facebook | LinkedIn | YouTube | TikTok

– Hotline: 0927 444 222 | Email: info@vnso.vn

– Trụ sở: Lô O số 10, Đường số 15, KDC Miếu Nổi, Phường Gia Định, TP. Hồ Chí Minh

– VPGD Đà Nẵng: 30 Nguyễn Hữu Thọ, Phường Hải Châu, Đà Nẵng

– VPGD Hà Nội: 132 Vũ Phạm Hàm, Phường Yên Hòa, Hà Nội